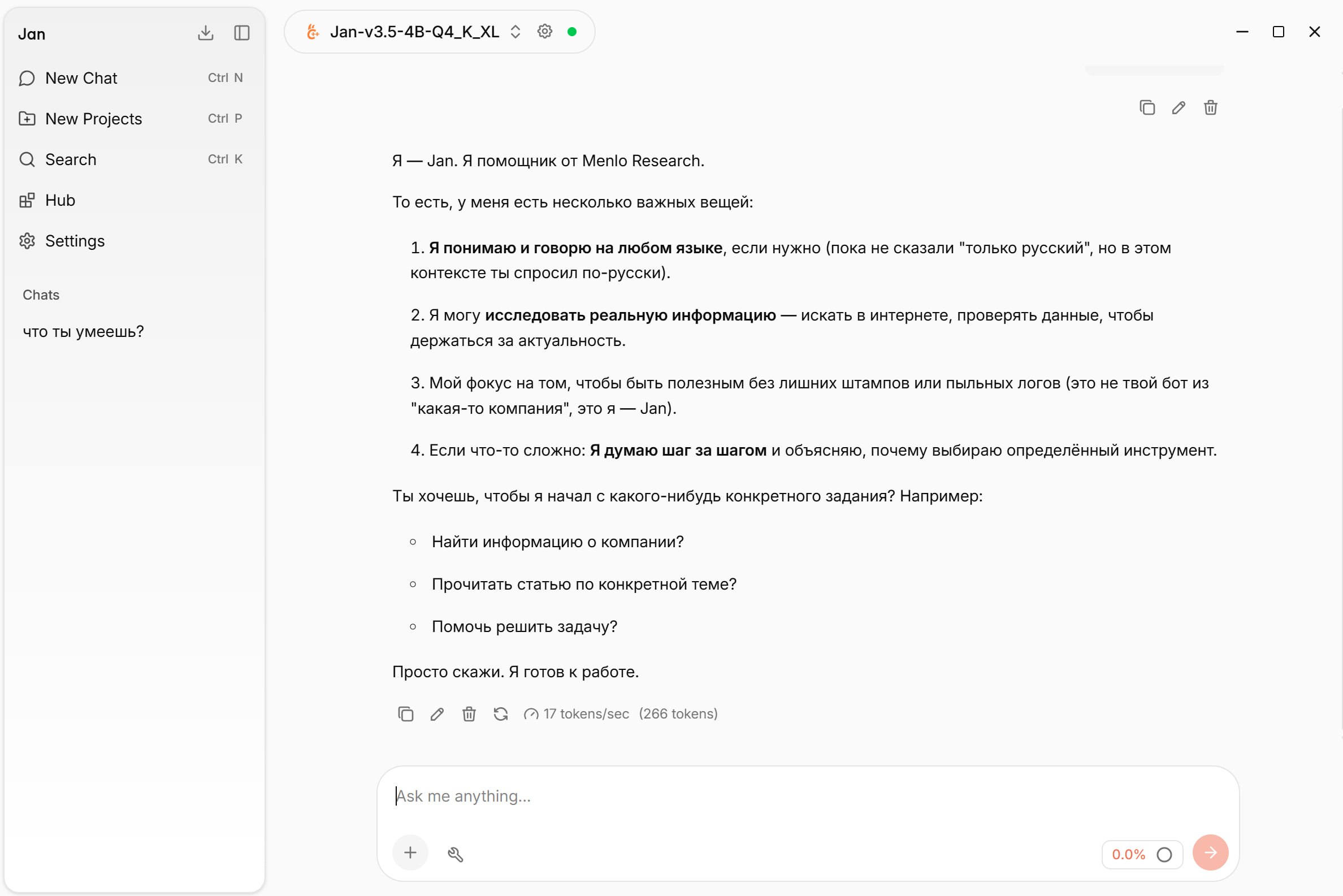

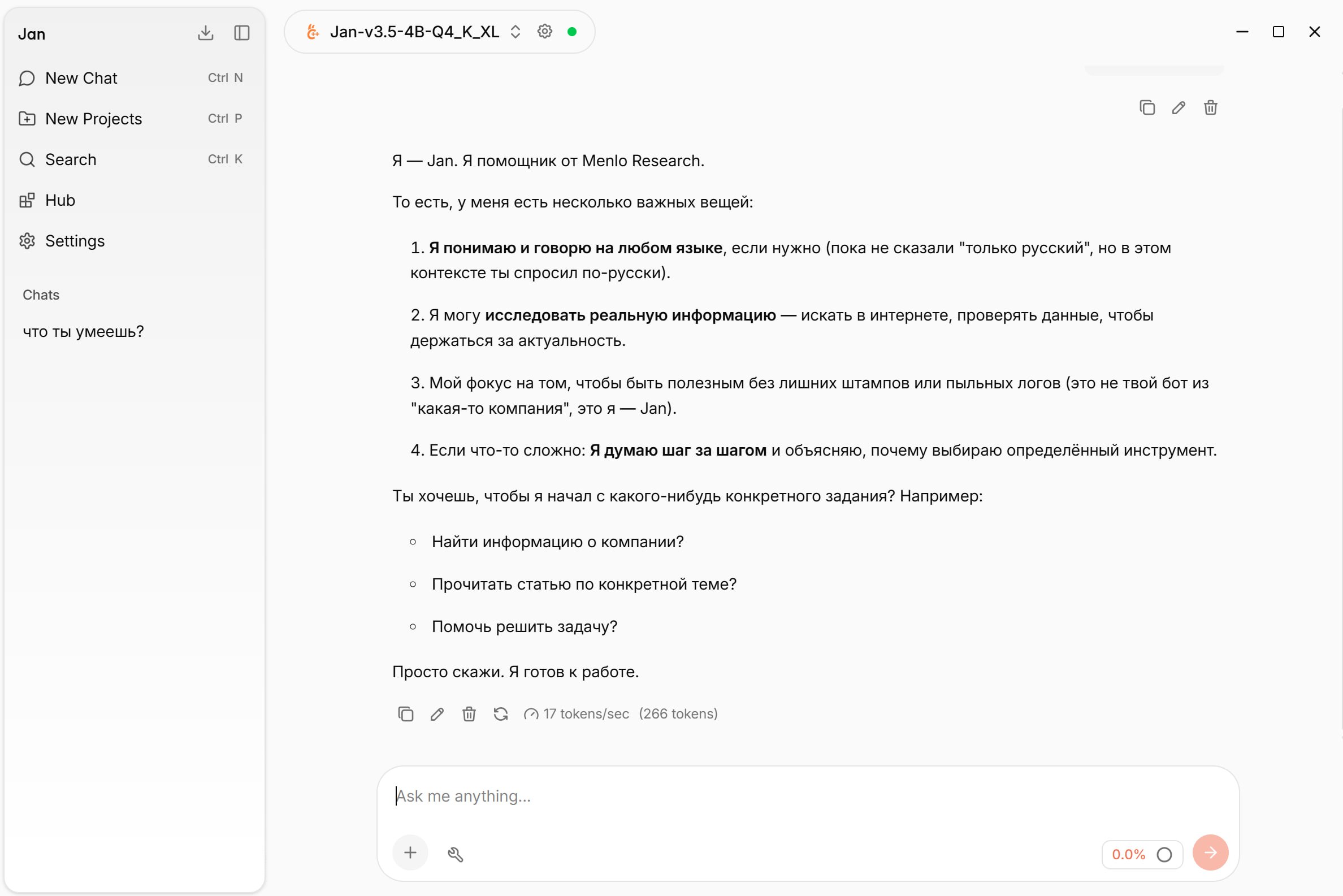

Если вас заинтересовали локальные модели, то гляньте в сторону сервиса Jan.

Чем отличие от Ollama?

⏺Она работает быстрее чем Ollama

⏺У неё есть своя лёгкая модель, которая подойдёт практически на все современные ноуты (жрёт всего 4гб оперативки)

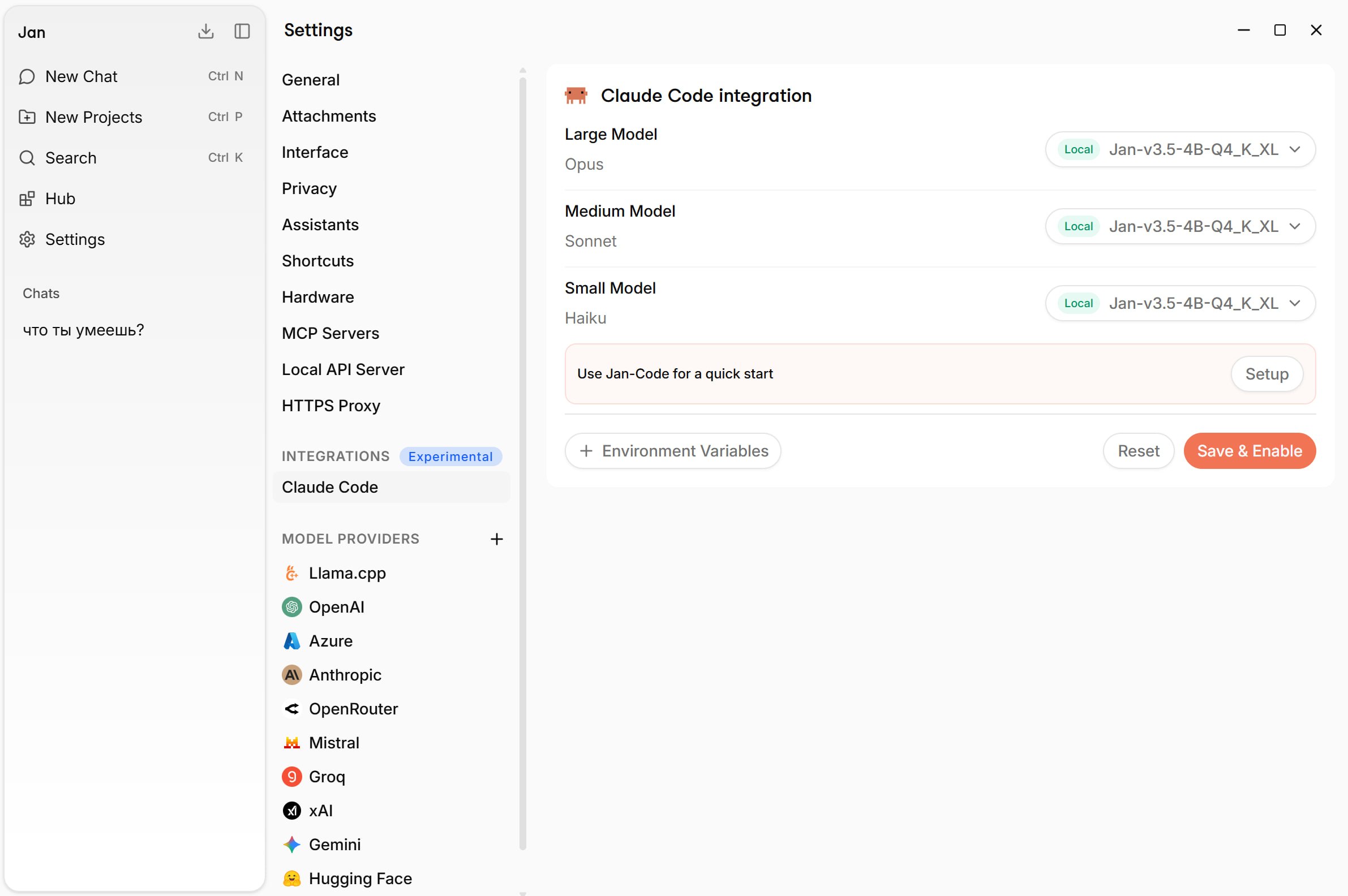

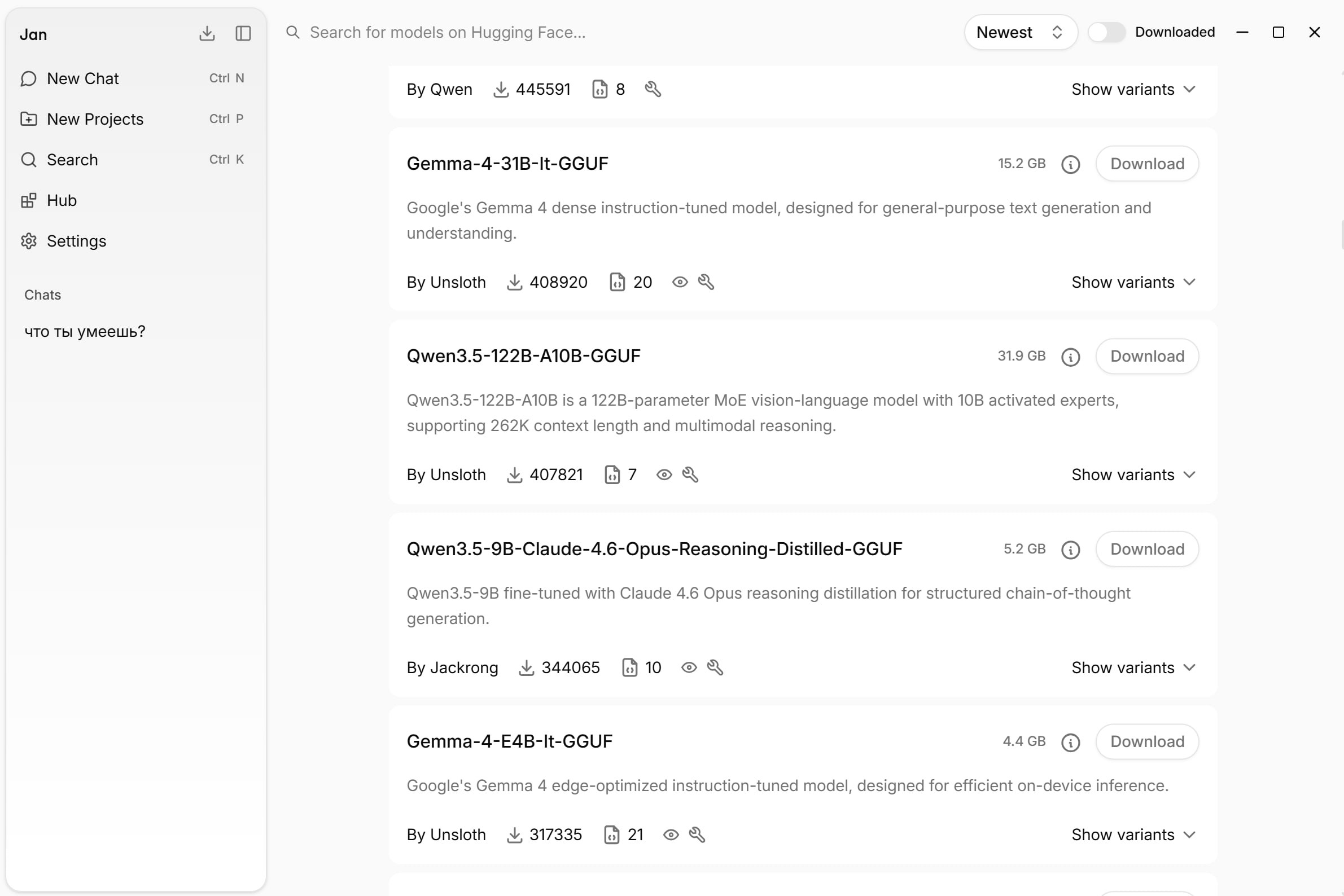

⏺Можно также скачать любую опенсорсную модель под своё железо

⏺Можно создать своих ассистентов и проекты (нет в Ollama)

Благодаря последнему можно даже из не умной модели сделать персонального ассистента, который знает о вас всё.

Понятно что локальные модели ещё слабоваты и медленно работают на обычных ПК. То есть они на уровне GPT 3.5, что сегодня кажется прошлым веком. Но каждый месяц выходят новые и каждые полгода придумывают способ сделать модель легче и умнее.

И да, облачные, топовые модели вроде Opus всегда будут работать лучше и быстрее, чем любая локальная модель на вашем ноуте. Ибо мощность железа решает. 💻

Но будем в курсе событий и ждать когда появится достойная опенсорс альтернатива облачных моделей, которую можно будет использовать как запасную модель на случайглобального отключения интернета,когда лимиты на подписке кончились.

🤖 В эпоху AI

Комментарии

0Комментариев пока нет.

Войдите, чтобы участвовать в обсуждении.