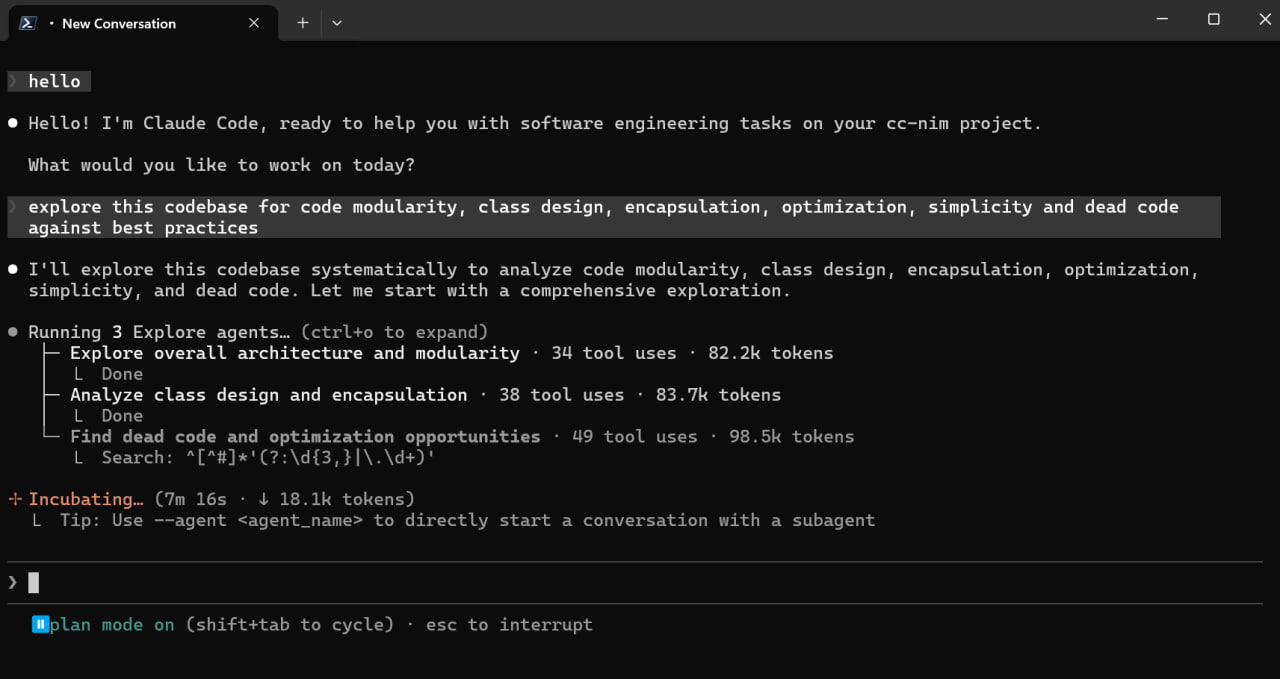

Запускаем Claude Code без ключа от Anthropic 🏴☠️

Недавно появился очень любопытный проект

free-claude-code. По факту это прокси-сервер на FastAPI, который подменяет собой эндпоинты Anthropic. Вы скармливаете ему запросы от оригинального Claude Code, а он роутит их куда вам выгодно: в бесплатный тир NVIDIA NIM, в OpenRouter, напрямую в DeepSeek или вообще в локальный LM Studio / llama.cpp.Что тут интересного (кроме очевидной халявы):

1️⃣ Heuristic Tool Parser

Дешевые или локально запущенные квантованные модели часто тупят с вызовом тулзов в строгом формате. Автор написал собственную стейт-машину (

providers/common/heuristic_tool_parser.py), которая парсит сырой текстовый выхлоп модели и прямо в стриме заворачивает его в легитимный Anthropic tool_use блок. Идеальный костыль для глупых моделей, чтобы заставить их работать с инструментами Claude.2️⃣ Перехват служебного трафика

В

api/optimization_handlers.py реализован локальный перехват "мусорных" реквестов. Claude Code под капотом постоянно шлет запросы на чек квоты, генерацию тайтлов для истории, автокомплит путей к файлам и саджесты. Прокси отбивает их сам захардкоженными ответами, вообще не дергая внешнюю LLM. Экономит время, деньги и лимиты.3️⃣ Трансляция рассуждений на лету

ThinkTagParser в реальном времени выкусывает теги <think> (привет, DeepSeek-R1) или извлекает reasoning_content из ответа провайдера, мапя их в официальные thinking блоки Anthropic. Для клиента это выглядит так, будто отвечает нативный Claude.Как дикий бонус: к прокси прикручен хендлер для Telegram и Discord. Можно натравить бота на локальную папку с проектом, кидать ему войсы (транскрибируются через локальный Whisper), а агент будет писать код у вас на компе. Идеально, если хочется пофиксить прод, пока едешь в такси (пожалуйста, не надо так делать).

Срочно пробовать! Отпишитесь потом, можно ли работает ли очередная спасительная халява ☕️

Комментарии

0Комментариев пока нет.

Войдите, чтобы участвовать в обсуждении.