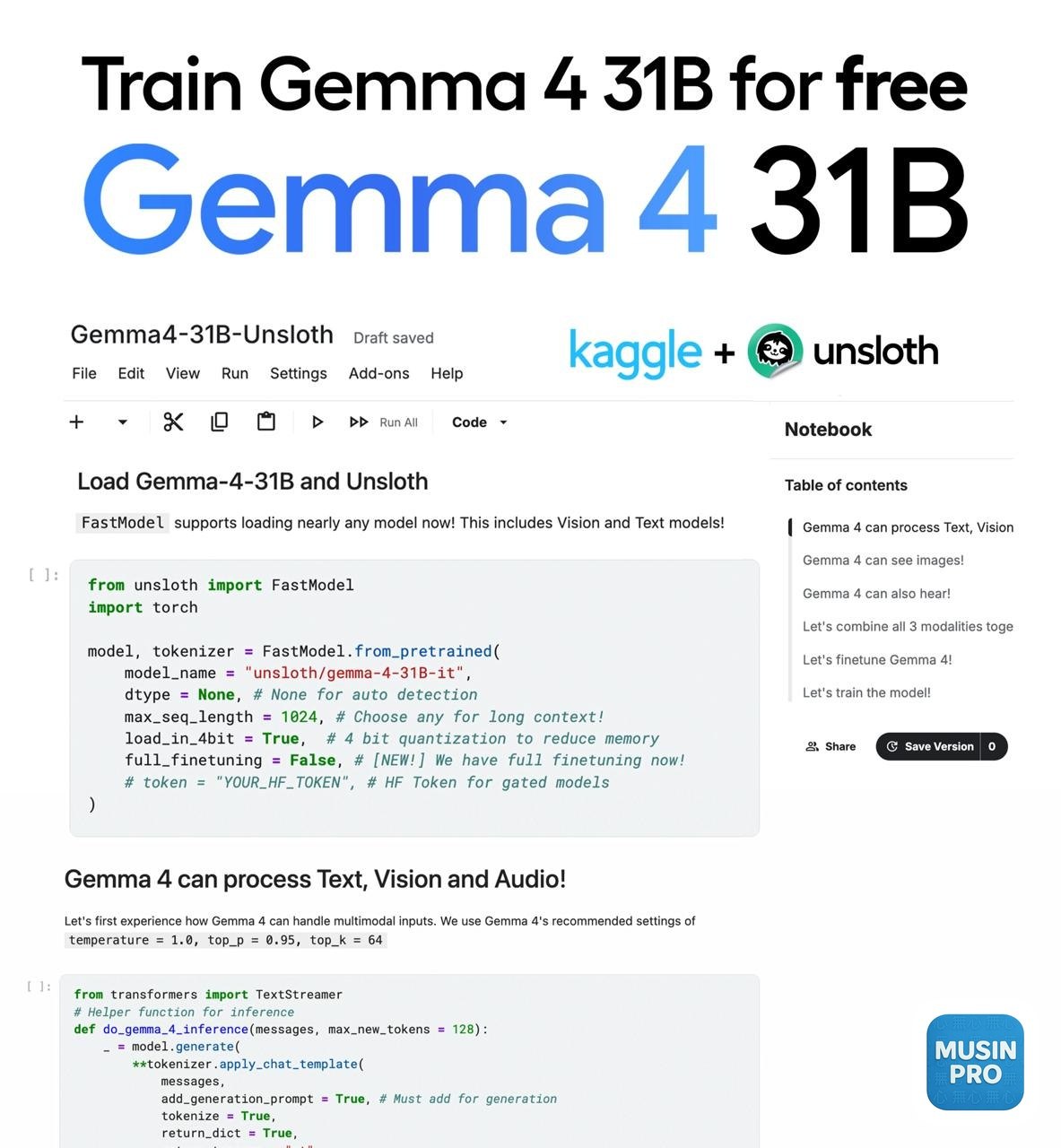

Файнтюн мультимодальных LLM для тех, у кого нет кластера A100 🦥

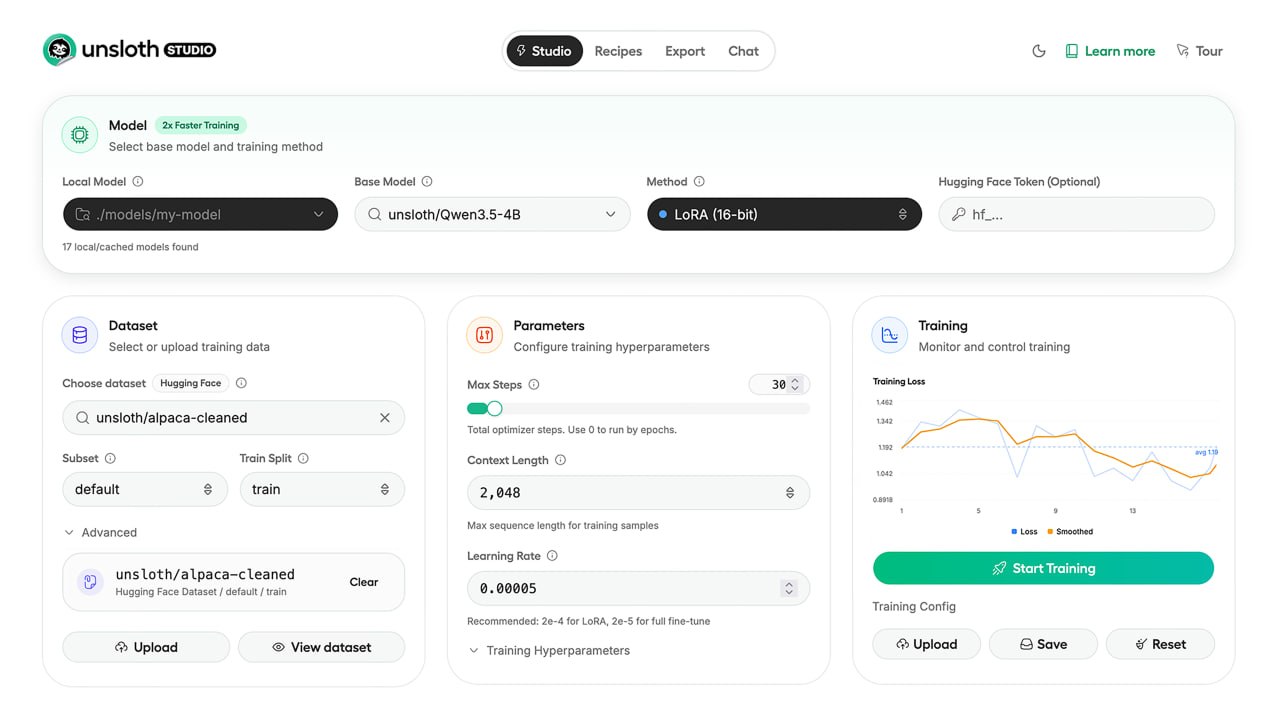

Ребята из Unsloth выкатили бету Unsloth Studio — локальной UI-тулзы для инференса и тренировки (Mac, Windows, Linux). Кроме того, они полноценно реализовали поддержку Gemma 4 от Google. И не просто обернули API, а руками починили критичные баги оригинальной архитектуры.

Чтобы завести LoRA для Gemma 4 E2B, вам хватит 8 Гб VRAM. Версия E4B влезет в 10 Гб. Если замахнулись на 31B — готовьте 22 Гб под QLoRA.

И да, если у вас вместо нормальной видеокарты затычка или макбук без MLX, Unsloth собрали готовый Colab-ноутбук.

Процесс максимально простой:

1️⃣Запускаем блоки и сам Unsloth Studio.

2️⃣ Выбираем модель, датасет . Просто закидываете свой датасет, выбираете нужные слои для обучения (у Gemma 4 теперь можно отдельно тюнить text, vision и audio слои) и идете пить кофе.

3️⃣ Жмём «Start Training» и наблюдаем за прогрессом в реальном времени.

4️⃣Всё готово - обычную и файн-тюн версию модели можно сразу сравнить в чате.