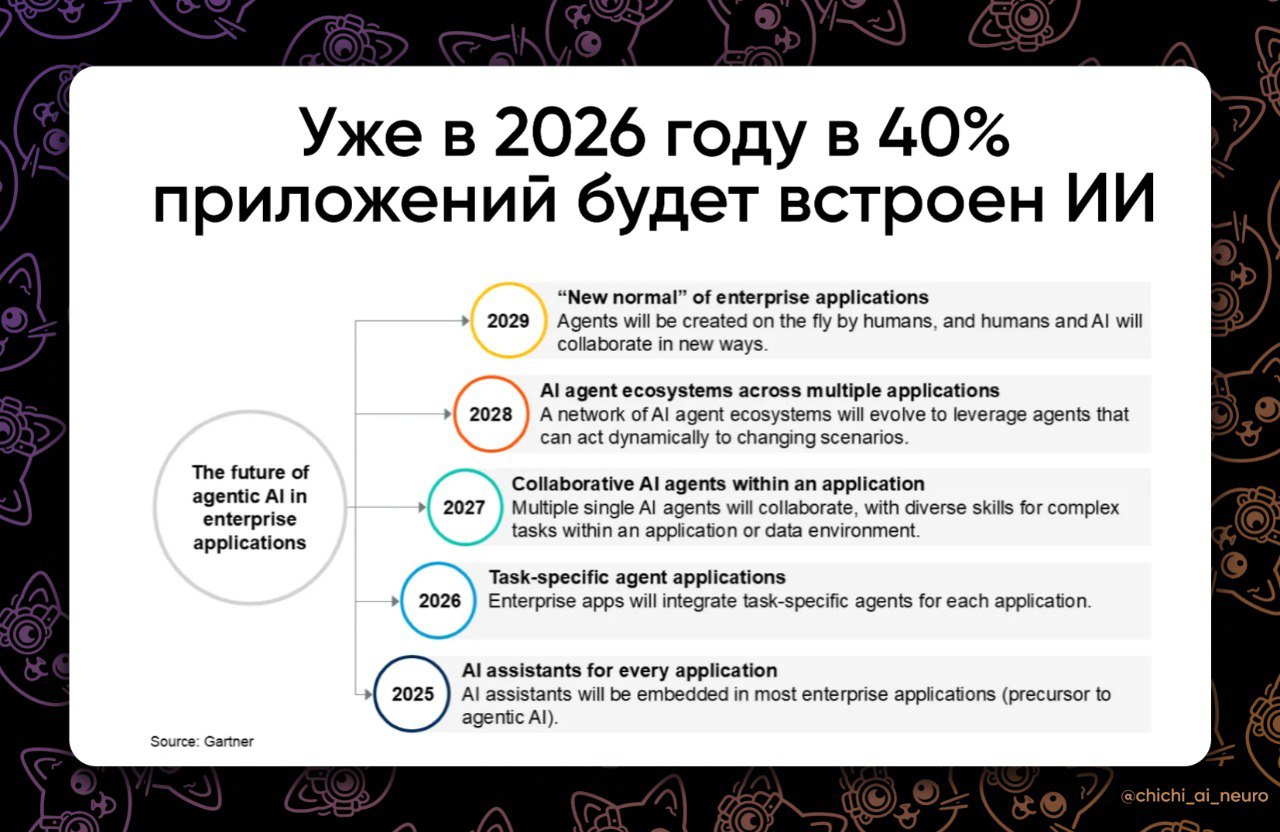

Уже в 2026 году в 40%

приложений будет встроен ИИ

Исследователь Нилеш Барла опубликовал большой обзор *The AI Research Landscape in 2026*, где ИИ подвёл итоги 2025 года и сделал прогнозы на ближайшие годы — и они выглядят жёстко .

Согласно анализу и данным Gartner, к середине 2026 года 40% корпоративных приложений будут использовать AI-агентов, тогда как в начале 2025 их было меньше 5%. Это восьмикратный рост за полтора года — ИИ окончательно выходит из экспериментов в прод.

Авторы отмечают, что главным прорывом 2025 года стало превращение моделей рассуждений в агентов: ИИ начал использовать вычисления во время тестирования и прокладывать сразу несколько путей рассуждений для одной задачи, а не один линейный ответ.

Следующий шаг — 2027 год: в приложениях появятся несколько ИИ-агентов одновременно, которые будут работать как коллеги — распределять роли, проверять друг друга и совместно решать сложные задачи.