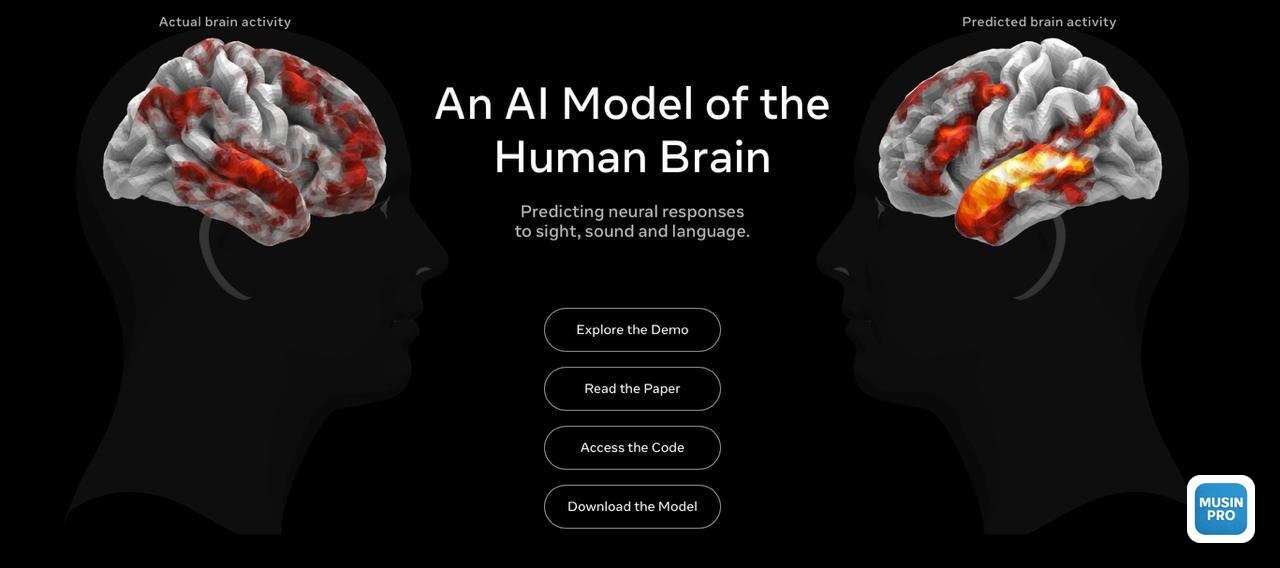

🧠 Meta выпустила TRIBE v2 — ИИ-модель, которая предсказывает активность мозга.

Не чтение мыслей. Скармливаешь модели видео, звук или текст — она предсказывает, какие зоны мозга активируются при восприятии этого контента. По fMRI.

Под капотом — три модели в одной: LLaMA 3.2 (текст) + V-JEPA2 (видео) + Wav2Vec-BERT (аудио). Zero-shot режим — переносит знания на новых людей без переобучения. Веса и код открыты, лицензия CC BY-NC 4.0.

Почему это важно для бизнеса:

— Фарма и medtech — виртуальный стенд для гипотез до дорогих клинических циклов

— Реклама и медиа — не «кликнул/не кликнул», а моделирование того, как мозг обрабатывает контент

— Наука — раньше для этого нужен был реальный fMRI-сканер и месяцы экспериментов

Следующая волна ИИ — не про офисные copilot-сценарии. Про цифровые модели человека: восприятие, внимание, речь, когнитивные состояния.

Где, по-вашему, это даст первый коммерческий эффект? 👇

MUSIN PRO | TRIBE v2

#AI #нейронауки #Meta #мозг #будущее