Если вы когда-нибудь переносили сложную математику из Python-кода в документацию, Javadoc или научную статью, вы знаете эту боль. Верстать трёхэтажные формулы на LaTeX руками — это отдельный вид мазохизма, где одна забытая

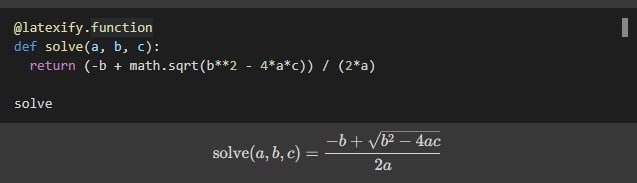

} отнимает двадцать минут на дебаг.Пакет latexify делает ровно одну вещь: транслирует Python-функции в математические формулы LaTeX.

Это не очередная LLM-обертка. Библиотека работает максимально детерминированно: она использует встроенный модуль

ast, чтобы распарсить абстрактное синтаксическое дерево вашей Python-функции, и по жестким правилам транслирует узлы AST прямо в LaTeX-разметку.Что она умеет на уровне AST:

🟢Распознает и конвертирует модули

math и numpy (math.sqrt станет \sqrt, math.gamma — \Gamma).🟢Разворачивает

if/elif/else в красивые кусочно-заданные функции (piecewise).🟢 Рендерит NumPy-матрицы.

🟢 Понимает операции над множествами (

&, | превращаются в \cap, \cup, если включить флаг use_set_symbols=True).🟢 Умеет генерировать не только формулы, но и псевдокод (декоратор

@latexify.algorithmic).В Jupyter Notebook или Colab декоратор

@latexify.function автоматически заставит ячейку отрендерить красивую формулу. Не нужно даже вызывать print().🔗 Исходники лежат на GitHub, а пощупать вживую можно в Google Colab.

#годный_опенсорс